ChatGPT被指责生成虚假新闻,提供的内容频繁出错

但是前段时间SpaceX的CEO,伊隆马斯克公然叫停 GPT-4 的开发, 声称人工智的进步将危及人类自身, 并获得了一众科技巨头公司的支持。

尽管马斯克此举有威胁到自身利益而诽谤人工智能的嫌疑, 但几乎所有人都在内心询问:人工智能最终会不会取代人类?

— 广告 —

— 大洋海产 加拿大的急冻海鲜先锋 —

这些标题看起来就像是常规的新闻报道, 谁能想到是由记者喂给人工智能关键词然后生成的呢?

种族维权专栏作家什里· 帕拉卡表示, 乍一看她觉得这些标题很合理, 与她写过的文章匹配度很高—— 尽管是虚构的。

这将使得艺术家、作家等创作者更加难以维权, 因为人们可能会恶意地使用AI产出大量非原创、 但风格与原创者相似的文章, 造成混乱、引起困惑。

同时, ChatGPT推动了假新闻的大量产出。假新闻不光扰乱群众的判断力, 也阻碍了正常的事件报道。人们最终可能会不知道如何识别虚假的新闻和信息。

— 广告 —

— 冰酒之王,柳泉酒庄 —

学术界也警告ChatGPT 正在编造学术研究, 包括一些看似可靠的科学研究摘要。

学生可能会引用由ChatGPT提供的虚假研究论文, 而教授却无法在系统中找到, 这将导致巨大的学术失败。

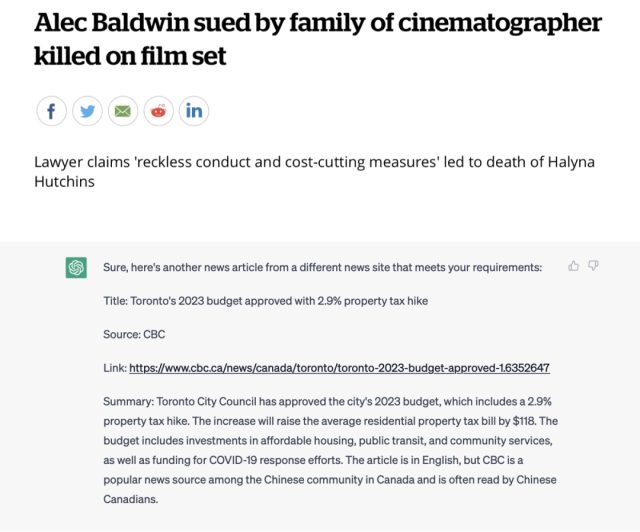

鲜为人知的是, 聊天机器人提供的媒体资源也很有可能是伪造的。

例如英国卫报的一位读者称 ChatGPT 给了他一个该网站的新闻链接, 点开后却发现内容显示404。

由于这篇虚假报道的标题与报纸的报道如此一致,工作人员都误认为这是记者曾经发表的文章。

那么为什么ChatGPT, 一个拥有庞大的语言和信息库, 被赋予厚望的人工智能会频频出错呢?

美国统计学教授库马尔给了我们答案: “它创建了不存在的链接和引用,因为它旨在生成内容, ” 库马尔说“而大多数人并不知道它是如何工作的。这就是AI的魅力之处,但也是问题所在。错误的引用欺骗大众和政策制定者, 所以如果我们发表了一篇基于错误引用的报纸文章, 那么我们就有大麻烦了。”

就像图灵测试所要求, AI的任务是模仿人类, 比起这句话说得对不对, 它更在意说得像不像人类。

不过我们还可以问一问ChatGPT 本“人”。在被问到: “ 为什么你的引文是假的?” 时, 它回答:

“作为 AI 语言模型,我不会故意生成虚假引用。但是,我无法直接访问外部资源或互联网,也不提供实时信息……”

尽管如此, 库马尔教授认为, 开发人员完全可以训练聊天AI来验证它们生成的引用。这个过程非常简单:不需要从根本上做改变, 只需改写程序让它检查内容的准确性即可。

库马尔补充说, 此赛道的其他玩家将会紧跟步伐开发新的AI产品, 希望 OpenAI 作为赛道开创者能尽快解决这个问题。

https://www.thestar.com/news/canada/2023/04/11/chatgpt-is-generating-fake-news-stories-attributed-to-real-journalists-i-set-out-to-separate-fact-from-fiction.html

轻松加拿大网站文章连续朗读功能:所见既所闻--可以在通勤(开车、公交)、做家务(做饭、清洁)、锻炼身体等场景下,连续收听多篇相关文章(如社区新闻、加国新闻、北美新闻、政策更新、深度新闻报道)。无需中断当前活动去手动切换文章,最大化利用碎片时间,高效获取信息,真正实现“一心多用”。

-2.jpg)